Les hypothèses de recherche et les développements technologiques sont liés à :

Au cœur de ce travail se trouve la construction d’un nouveau guide ainsi que l’évaluation et la compréhension de l’expérience utilisateur/utilisatrice. D’une part, le projet IMG fournit un outil essentiel pour enrichir l’accès aux œuvres d’art 2D pour les personnes aveugles et partiellement aveugles dans les musées et les lieux du patrimoine culturel. D’autre part, il offre une expérience multisensorielle qui enrichit et approfondit l’expérience des œuvres d’art 2D de toutes et tous.

Le projet IMG cherche à fournir une équivalence fonctionnelle et non sensorielle, basée sur le principe que des représentations mentales enrichies d’œuvres d’art émergeront par des actions sensorielles, des actions motrices et une description verbale simultanées. Ainsi, en tant qu’outil inclusif, la technologie ad hoc peut contribuer à l’émergence de nouvelles impressions esthétiques qui peuvent être partagées avec d’autres, indépendamment de l’expérience visuelle.

Travailler avec des chercheurs/chercheuses et des utilisateurs/utilisatrices finaux ayant une incapacité visuelle nous permet de mieux comprendre le processus mental qui mène à l’émergence d’impressions esthétiques d’œuvres d’art chez les personnes aveugles, partiellement aveugles et non-aveugles.

Le projet IMG considère les stimulations sensorielles telles que visuelles, sonores et tactiles, les actions motrices telles que haptiques combinées à la compréhension cognitive extraite de la parole (audiodescription).

La théorie sensorimotrice de la perception fournira un cadre pour ces nouvelles façons d’expérimenter l’art qui peuvent être renforcées (assistées) par nos perceptions et les actions associées. De plus, dans le cadre de la notion de « gain de cécité » ce projet aboutira à la création de nouvelles façons d’accéder aux œuvres d’art 2D, tant pour les utilisateurs et utilisatrices aveugles et partiellement aveugles que pour ceux et celles qui voient, de manière à repenser les façons traditionnellement visuelles d’accéder à l’art. IMG le fait en combinant l’art de la description (décrivant spécifiquement les arts visuels de manière non visuelle) comme un outil pour améliorer l’accès de toutes et tous avec l’expérience haptique et auditive (avec ou sans vision).

De plus, les résultats de nos évaluations expérimentales préliminaires auprès des utilisateurs et utilisatrices finaux (aveugles et partiellement aveugles et non-aveugles) des représentations de données 2D de base affichées sur les appareils de stimulation tactile existants ont confirmé que:

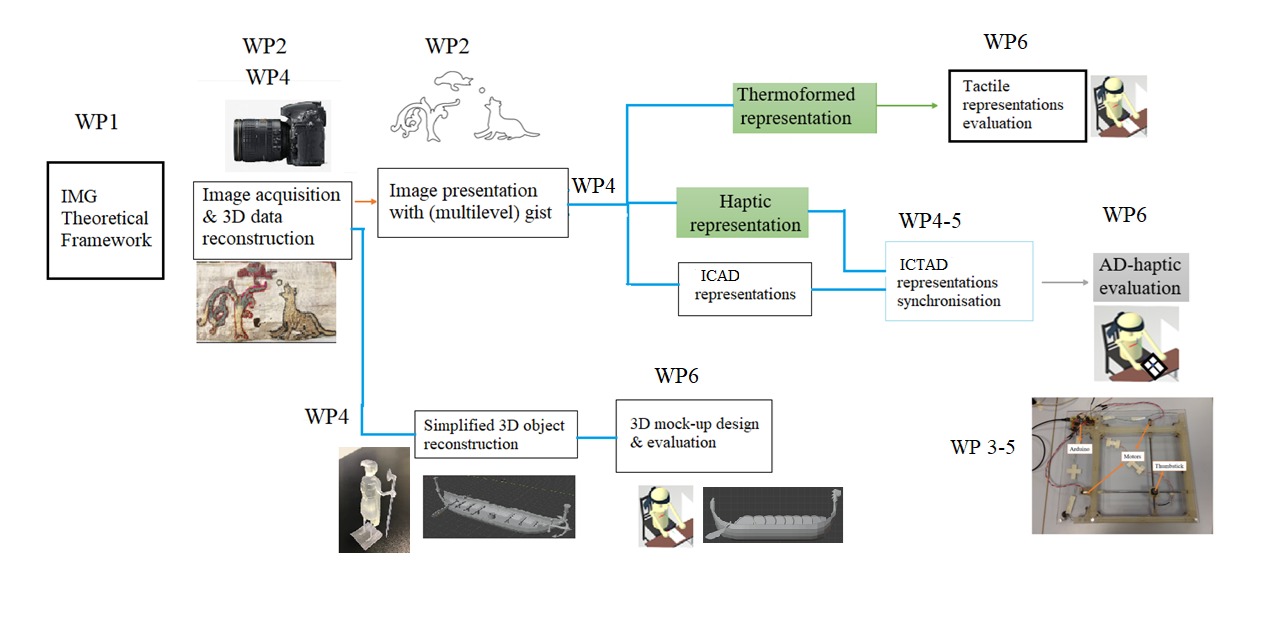

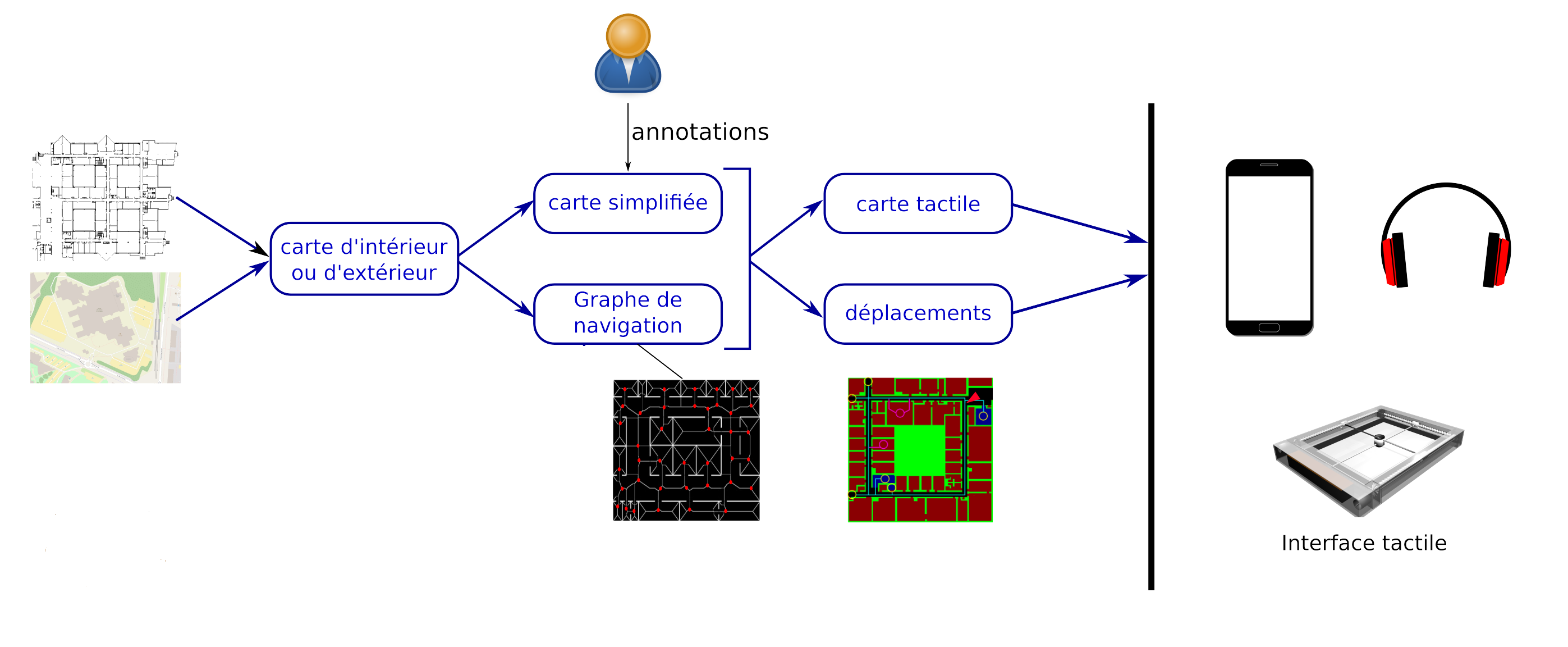

Le projet IMG vise à prototyper un nouvel outil de guidage muséal numérique multimodal programmable, interactif et portable (cf. figure 2 et figure 3), adapté à tous les niveaux de vision (totalement aveugle à partiellement aveugle). Cet outil construira, à partir d’images acquises avec un système de vision ad hoc, la représentation multimodale des objets/scènes imagés (carte audio-tactile, représentation audio-tactile d’une œuvre d’art, et objets reconstruits en 3D - maquettes).

Figure 2

Figure 3

Le système IMG est composé de matériel et de logiciels coopérants. Ses éléments matériels sont les suivants : un écran (où une image est affichée); un boîtier mécatronique adaptable à la taille de n’importe quel écran et nommé F2T (force feedback tablet), un système de vision et un casque à conduction osseuse (en option). Un ou plusieurs joysticks mobiles et un jeu de touches sur le F2T permettront aux visiteurs et visiteuses du musée d’interagir avec l’écran (création d’images visuelles-tactiles-haptiques).

Plusieurs applications de base (logiciels) seront développées pour permettre la création et l’ajout de cartes géographiques tactiles (intérieures et extérieures), fournir des outils de localisation et de suivi et créer une représentation haptique et interactive combinée à une audiodescription.

Il sera possible de comprendre par le toucher (sans voir), de telles représentations multimodales grâce aux techniques de traitement d’image et de vision par ordinateur. Des algorithmes spécifiques de segmentation des images seront conçus afin de simplifier les images des œuvres, d’en extraire les caractéristiques les plus saillantes, identifiées en collaboration avec les conservateurs/conservatrices de musée et les personnes aveugles et partiellement aveugles, et de les transposer sur la F2T.

Une sensation de profondeur et de texture de l’œuvre sera fournie aux personnes aveugles et partiellement aveugles en créant des maquettes imprimées en 3D haute résolution. De tels modèles 3D seront automatiquement créés en combinant des nuages de points estimés à l’aide de systèmes de type LIDAR avec des estimations d’orientation de surfaces de haute précision obtenues en transformant un système existant d’imagerie par transformation de réflectance (RTI) en une plate-forme de reconstruction 3D photométrique stéréo. Enfin, une bibliothèque de programmation de base sera construite pour la conception d’applications open source utilisant des langages de programmation de haut niveau.

Chartes relative à l'audiodescription

Articles publiés dans des Revues

Publications

Conférences Internationales

Conférences Nationales

Communications

Workshop

MOOC

Rapports Scientifiques

Film présentant notre tablette à retour de force